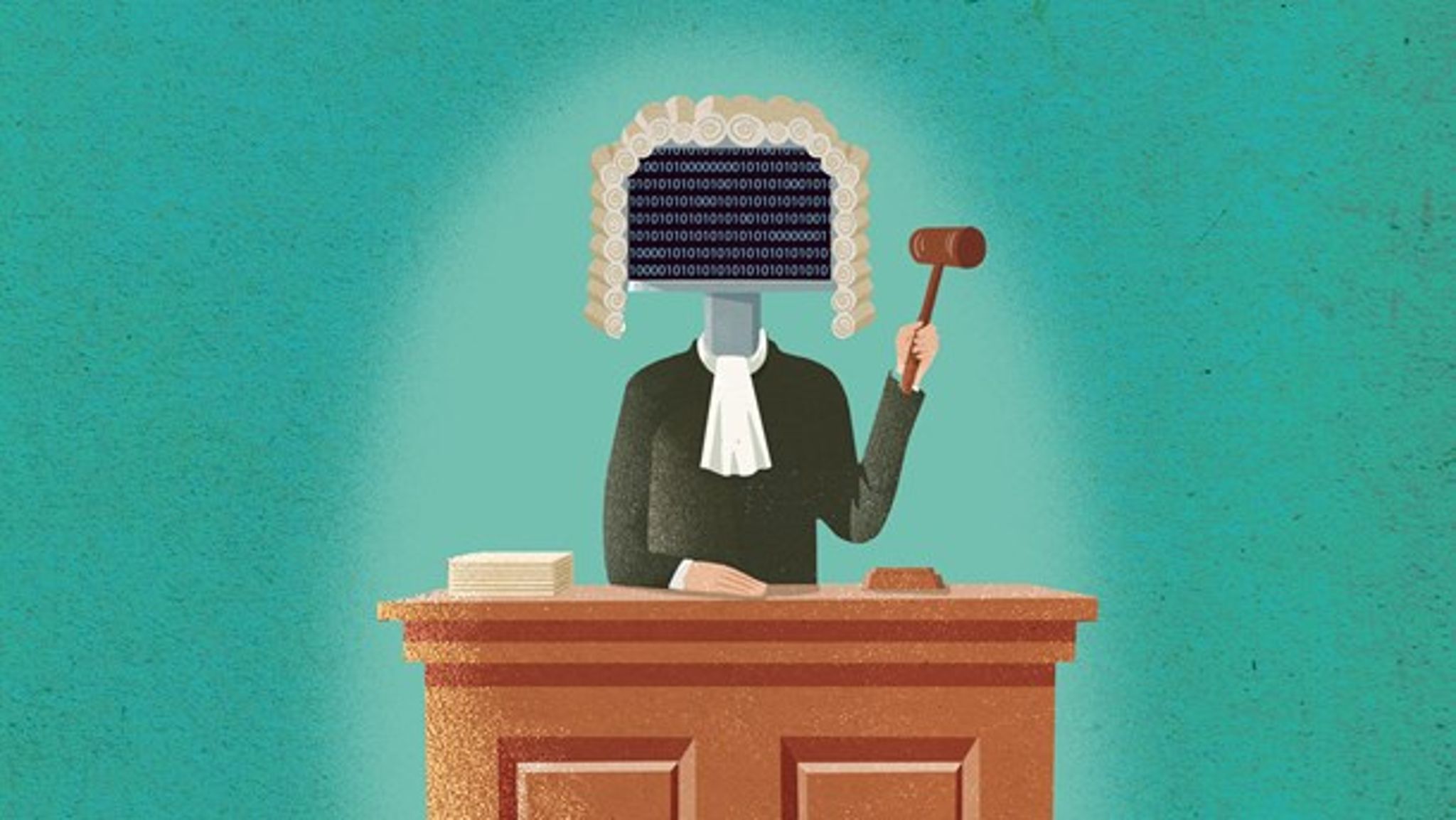

Kan kunstig intelligens skabe retfærdighed?

18. november 2019 kl. 05.00

MM Special: Retsafgørelser med digital præcision

Kort sagt

Computere er både billigere, hurtigere og ofte mere præcise end højtuddannede advokater. Der er derfor meget at vinde ved at give computere plads i retsvæsenet. Men det er vigtigt at finde en balance, der sikrer, at den menneskelige dømmekraft ikke bliver sat ud af spil.

Vil du have adgang til Mandag Morgen?

Analytisk journalistik om samfundets omstillinger – og hvordan de former fremtiden.

Allerede abonnent? Log ind